Колись фотографія вважалася беззаперечним доказом, фактом, аж доки не з’явився Photoshop. І хоч це похитнуло довіру до знимків, ситуація була не такою критичною, як зараз – в епоху стрімкого поширення штучного інтелекту.

Ще п’ять років тому чат-боти сприймалися радше кумедно, а генератори зображень і відео створювали щось абстрактне й незрозуміле. Нині ж ситуація змінилася: чат-боти на кшталт ChatGPT чи Bard навчилися настільки майстерно імітувати людське мовлення, що їх використовують не лише для пошуку інформації, а як співрозмовників. Фото- та відеоконтент, створений ШІ, дедалі складніше відрізнити від реального.

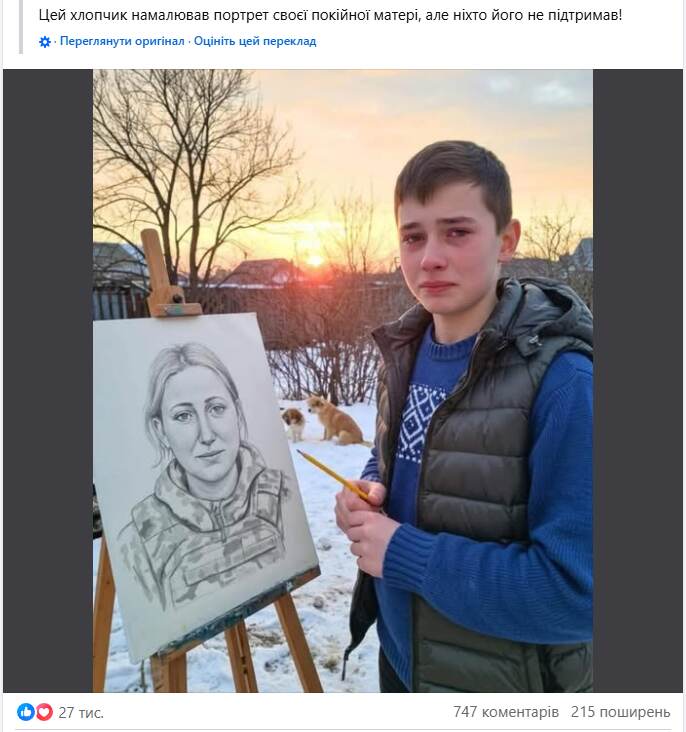

Звісно, цим прагнуть скористатися різні «креатори» заради лайків, переглядів, збільшення аудиторії і монетизації. Однак основна проблема не в тому, що люди заробляють на згенерованому контенті, а в тому, що він може вводити аудиторію в оману, створюючи фейки, які довірливі користувачі швидко розповсюджують.

Нині відомо безліч нейромереж для генерації зображень. Серед найпопулярніших – Midjourney, Bing Image Creator, DALL-E або DeepAI та інші. І вони досить прості у використанні. Правильний запит допоможе створити зображення, яке відображатиме все, на що здатна ваша фантазія. Як і будь-яка подібна технологія, вона має благі наміри: спрощувати роботу зі створення ескізів, пошуку референсів чи навіть створення мемів.

Однак головна небезпека — це, звісно, загальний доступ. Шокуючий контент, незалежно від його правдивості, гарантовано отримає широке поширення й високі показники взаємодії. Тепер не потрібно бути досвідченим графічним дизайнером, щоб створити фейк — достатньо лише ввести промт. При чому текст запиту може допомогти сформулювати ChatGPT, що зробить зображення ще якіснішим.

Подібна технологія небезпечна для довірливих або емоційно вразливих користувачів мережі, особливо під час війни.

Наприклад, широко розповсюджене фото «Авдіївка просить молитви» – типовий штучно згенерований контент. Ця публікація проаналізована багатьма медійними й фактчекерськими спільнотами, як приклад, завдяки якому можна навчитися розпізнавати штучно згенеровані фейки. Багато користувачів не звертають уваги на очевидні ознаки підробки: неприродні руки, помилки в прапорах, відсутність деталей.

Наприклад, широко розповсюджене фото «Авдіївка просить молитви» – типовий штучно згенерований контент. Ця публікація проаналізована багатьма медійними й фактчекерськими спільнотами, як приклад, завдяки якому можна навчитися розпізнавати штучно згенеровані фейки. Багато користувачів не звертають уваги на очевидні ознаки підробки: неприродні руки, помилки в прапорах, відсутність деталей.

Мета зрозуміла – емоційно вплинути на людей у складний час заради вподобайок, а ще зібрати аудиторію, якій згодом можна нав’язати потрібний контент, наприклад, політичний або комерційний. Я не можу зрозуміти лише одного: що заважає витратити годину у Photoshop і все виправити?

Журналісти StopFake, у своїй публікації на цю тему, показали артефакти штучного генерування, через які можна викрити фейк.

Неправильно зображені кінцівки (одна нога відсутня або зображена неприродно, а пальці руки мають неприродне положення); боковий підсумок невстановленого зразка; відсутні корпус і приклад автомата (до того ж, сама зброя не відповідає жодній моделі, що перебуває на озброєнні Збройних Сил України); нарукавний шеврон виконаний з порушенням — неправильні розміри та кольори українського прапора і ще багато нюансів.

Одразу стає зрозуміло, що люди, які прагнуть лайків, вигадуватимуть усе нові способи маніпуляції емоціями користувачів. Артефакти штучної генерації, за умови вмілого користування Photoshop, не складно виправити.

Такий результат — лише експеримент. Його вдалося реалізувати за одну годину. Майже всі артефакти усунені вручну. Так, знаю, виглядає все ще не надто природно, але я навіть не намагався досягти ідеалу. І де мої тисячі лайків? Їх не буде — і правильно. Бо створювати подібне, навіть у тестових цілях, — це ризикований шлях. Саме тому я обрав давній фейк, який уже бачили всі.

Я всього лише хотів лише продемонструвати, що методи виявлення штучного інтелекту перестають працювати, щойно фейкмейкер витрачає трохи більше часу. Якщо людина редагує згенероване зображення після нейромережі, допрацьовуючи його вручну — фейк стає набагато небезпечнішим. Саме таке зображення може легко ввести в оману навіть величезну кількість людей.

Єдиний дієвий захист — критичне мислення та опора на перевірені джерела. Поки інтернет-шахраї експлуатують наші емоції, проблема лише посилюється.

Найбільша загроза — не в самих фейках, а в тому, що люди надто легко їм довіряють. Доки медійники спростовують маніпуляції, інші — активно їх поширюють, створюючи ще більший інформаційний хаос.

Сергій Микович, студент відділення журналістики